Armazenamento de objetos compatível com S3 para desenvolvedores africanos: sem sustos na fatura de egress

Publicado: · Atualizado: · 5 min de leitura · Por Oluniyi D. Ajao

Avaliando alternativas ao Amazon S3? A API do S3 é o padrão de facto para armazenamento de objetos: praticamente toda ferramenta de desenvolvedor traz integração compatível com S3, e recorrer a boto3 ou s3cmd é memória muscular para a maioria. Mas para as cargas que desenvolvedores africanos costumam rodar, o modelo de preços do provedor dominante é difícil de conviver.

Uma biblioteca de mídia WordPress para um site que atende leitores nigerianos. Um backup de Postgres sendo restaurado para uma máquina de staging em Joanesburgo. Um serviço de vídeo sob demanda para audiências no Quênia. Nos três, o custo dominante é o egress: banda saindo do bucket para o consumidor ou o destino do restore: e o preço de egress dos grandes provedores é genuinamente punitivo. As tarifas típicas ficam entre US$ 0,08 e 0,12/GB nos primeiros terabytes, caindo em escala petabyte, e maiores a partir de deployments em regiões africanas. Uma página de produto de e-commerce popular com algumas imagens pode vazar centenas de dólares por mês em egress sem ninguém notar até a conta chegar.

Essa é a lacuna que uma alternativa compatível com S3 pode preencher: a mesma API que os desenvolvedores já conhecem, a mesma classe de durabilidade, mas com um modelo de preços que não sangra na banda.

O que uma alternativa realmente compatível com S3 precisa entregar

Três requisitos técnicos e um comercial:

- Compatibilidade com a API S3. Não «a gente tem um object store com uma API diferente»: compatibilidade real com a API S3. O ponto é que todo SDK, todo pipeline de CI/CD, toda ferramenta de backup fala nativamente. Se você precisa reescrever código para adotar uma API diferente, o custo de migração anula a economia.

- Durabilidade da mesma ordem de grandeza. O serviço líder anuncia 99,999999999 % (onze noves) de durabilidade via replicação multi-AZ. Uma alternativa não precisa igualar isso exatamente: nove noves dão conta da maioria das cargas: mas precisa estar na mesma conversa. Um NAS de máquina única com RAID-6 não qualifica.

- Consistência leitura-após-gravação. O incumbente oferece consistência forte leitura-após-gravação desde 2020. Alternativas ainda com consistência eventual vão te morder em qualquer workflow em que um objeto recém-enviado é lido imediatamente: que é a maioria dos workflows.

- Preço de banda previsível. É o ponto central. Se a alternativa cobra banda em tarifas de hyperscaler, não há razão para trocar. Banda inclusa com tarifa fixa, ou um modelo em níveis claro, é o que faz a conta fechar para cargas com audiência africana.

O armazenamento de objetos da AFRICLOUD como alternativa

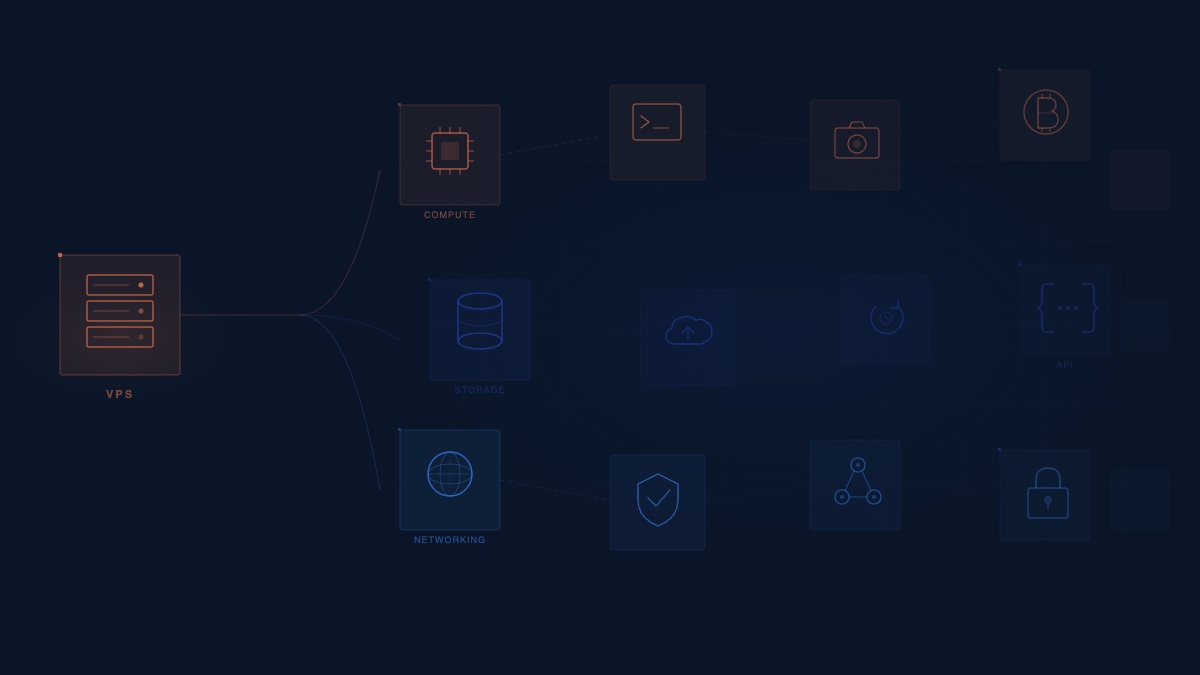

A AFRICLOUD oferece armazenamento de objetos compatível com S3 a partir dos nossos data centers em Lisboa e Joanesburgo: os dois locais de onde operamos VMs cloud. O endpoint fala a API S3, então as ferramentas existentes funcionam sem alteração: aws-cli com override de endpoint, boto3 com endpoint_url setado, rclone, Duplicati, o adaptador S3 de qualquer CMS moderno. A durabilidade é multi-réplica dentro do data center; o padrão de acesso é idêntico a serviços S3-compatíveis padrão.

Para cargas com audiência africana especificamente: servir mídia para usuários nigerianos, ganeses ou quenianos a partir do nosso endpoint de Joanesburgo roteia via NAP Africa (o maior IXP do continente, com mais de 580 redes em peering) em vez de fazer o tráfego ir e voltar até uma região distante. Para audiências europeias e norte-africanas, Lisboa é o caminho geograficamente mais curto: Marrocos, Tunísia e Egito rodam todos abaixo de 70 ms a partir do nosso endpoint de Lisboa.

Onde o serviço líder ainda vence

Três casos genuínos para ficar com o incumbente:

- Integração profunda do ecossistema. Se seu pipeline depende de eventos de object-store disparando funções serverless ou jobs de treino de ML no mesmo ecossistema do provedor, migrar apenas o armazenamento de objetos cria egress cross-cloud que anula a economia.

- Entrega edge global. Um CDN fortemente integrado mais um object store te dão presença edge continental com um clique. Se sua audiência é globalmente distribuída e você precisa de edge em toda região, uma alternativa com menos PoPs é genuinamente mais lenta.

- Preço de arquivo frio. Para dados genuinamente frios acessados menos de uma vez por ano, os níveis deep-archive em torno de US$ 0,001/GB/mês são difíceis de bater. Uma alternativa de armazenamento de objetos sem nível frio custa mais para esse caso específico.

Caminho de migração

Para a maioria dos buckets com audiência africana, a migração é um único comando rclone sync e uma atualização de configuração na aplicação. Três passos:

- Configure o rclone com ambos os endpoints S3-compatíveis de origem e destino. Um

~/.config/rclone/rclone.confpadrão com dois remotes. - Sincronize o bucket.

rclone sync origem:seu-bucket destino:bucket-destino --progress. A cobrança de egress da origem é real (uma última fatura na saída), então para buckets grandes, planeje o orçamento. - Atualize sua aplicação. Mude a URL de endpoint na sua config para apontar para o novo provedor. Para a maioria dos SDKs isso é uma única variável de ambiente ou uma linha de código (

boto3.client("s3", endpoint_url=...)).

Teste primeiro com um bucket pequeno só-leitura, verifique se os padrões de acesso batem, e depois migre produção. Se você usa URLs pré-assinadas para downloads, verifique se elas funcionam contra o novo endpoint: devem funcionar, já que é a mesma API, mas vale a pena verificar a rotação de credenciais antes do corte.

Veja nossa página de Object Storage para preços atuais e quickstart, ou fale com a gente para discutir os detalhes de migração para sua carga.

Artigos relacionados

NVMe e armazenamento cloud: por que o tipo de armazenamento importa para o seu VPS

Apr 14, 2026

Alternativa cloud para desenvolvedores africanos: o que avaliar antes de migrar

Apr 23, 2026

AFRICLOUD Evolui de Hospedagem VPS para uma Plataforma Completa de Infraestrutura em Nuvem

Mar 2, 2026

NVMe essencial para e-commerce africano acelerado

Sep 25, 2025